Die Welle der künstlichen Intelligenz, insbesondere in Form generativer Modelle wie ChatGPT, rollt unaufhaltsam über unsere Arbeitswelt und Bildungsinstitutionen hinweg. Einst als allmächtiger Jobvernichter gefürchtet oder als universeller Problemlöser gefeiert, zeichnet sich nun ein differenzierteres Bild ab: KI erweist sich weniger als simple Entweder-oder-Entwicklung, sondern vielmehr als ein komplexes Phänomen, das Effizienzpotenziale freisetzt, neue Fähigkeiten erfordert und uns zwingt, ethische Leitplanken und pädagogische Konzepte fundamental zu überdenken. Die anfängliche Hysterie weicht einer Phase der pragmatischen Auseinandersetzung, in der die Konturen einer neuen Koexistenz von Mensch und Maschine sichtbar werden – einer Koexistenz, die jedoch nicht frei von Spannungen und Herausforderungen ist.

Vom Schreckgespenst zum Assistenten: KI im Berufsalltag

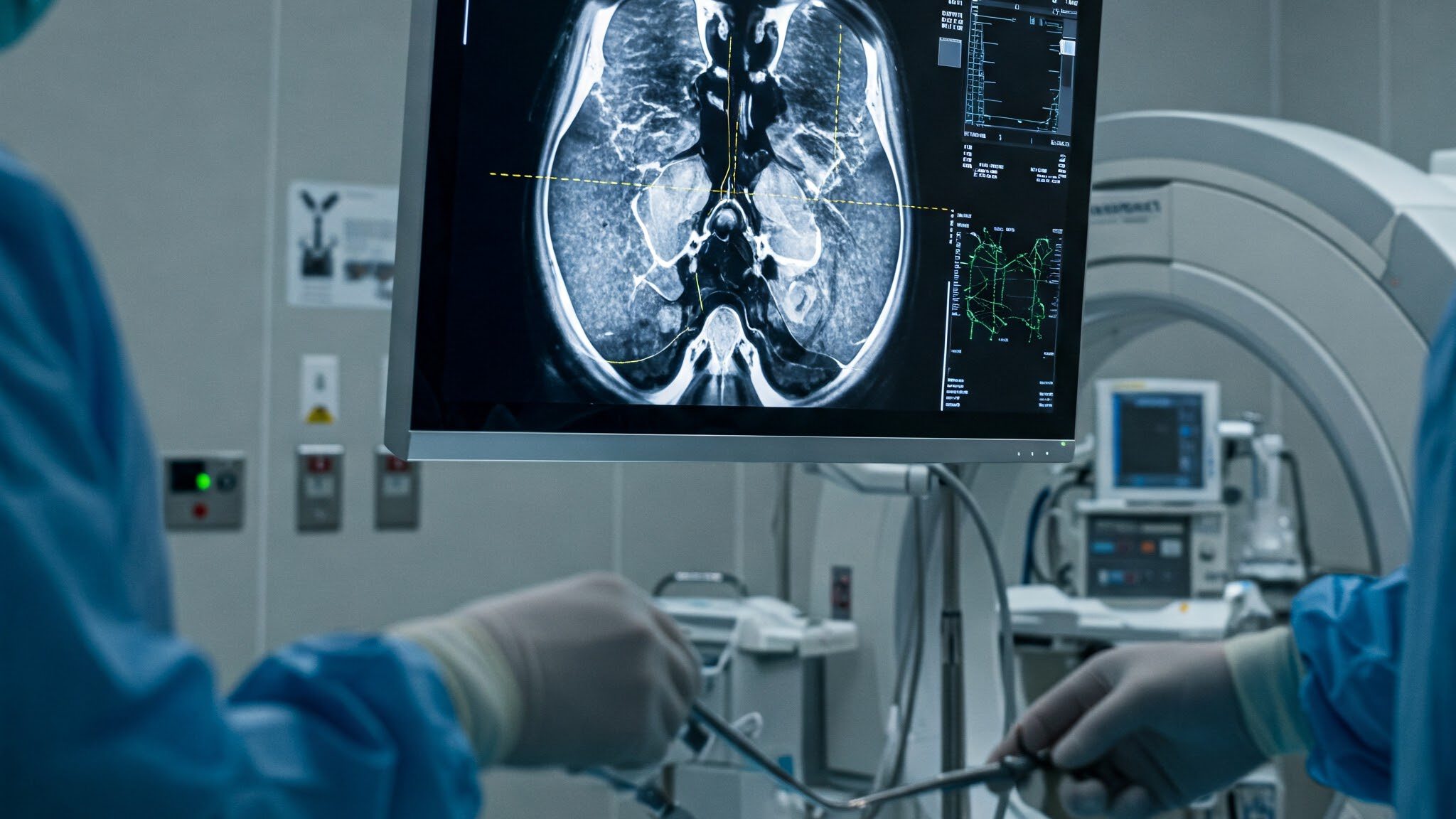

Die Prophezeiungen, KI würde in kürzester Zeit ganze Berufsgruppen obsolet machen, haben sich bisher nicht in dem befürchteten Ausmaß bewahrheitet. Prominente KI-Forscher wie Geoffrey Hinton, der noch 2016 das Ende der Radiologieausbildung vorhersagte, mussten ihre Prognosen zumindest zeitlich revidieren. Das Paradebeispiel der Mayo Clinic, wo Radiologen KI nicht als Jobkiller, sondern als Effizienz-Booster erleben, illustriert diesen Wandel eindrücklich. Dort dient KI als „zweites Augenpaar“, schärft Bilder und automatisiert Routineaufgaben, ohne jedoch die komplexe diagnostische und beratende Rolle des Facharztes zu ersetzen. Die Belegschaft in der Radiologie der Mayo Clinic ist seit Hintons Prognose sogar um 55 Prozent gewachsen. Ähnliche Entwicklungen zeigen sich bei Textern und Kreativen: Organisationen wie das American Writers and Artists Institute betonen, wie ChatGPT Schreibprozesse beschleunigen und Freiräume für strategischere Aufgaben schaffen kann, anstatt Autoren gänzlich zu verdrängen. Der entscheidende Faktor scheint die Komplexität der jeweiligen Tätigkeit zu sein: Je vielschichtiger die Aufgaben und je mehr menschliche Interpretation und Interaktion gefragt sind, desto eher fungiert KI als unterstützendes Werkzeug denn als vollständiger Ersatz. Dennoch bleibt die Sorge, wie eine Umfrage von ZipRecruiter zeigt, bei 62 Prozent der Arbeitssuchenden bestehen, dass KI ihre Karrieren gefährden könnte.

US Politik Deep Dive: Der Podcast mit Alana & Ben

Mehr als nur ein Werkzeug: Die transformative Kraft der neuen KI-Generation

Die aktuelle Generation von KI-Systemen, allen voran große Sprachmodelle (LLMs) wie ChatGPT, unterscheidet sich qualitativ von früheren technologischen Innovationen. Während traditionelle Software vorprogrammierten Regeln folgte, lernen diese neuen Systeme aus riesigen Datenmengen und können eigenständig menschenähnliche Texte, Bilder oder Code generieren. Ihre Fähigkeit zum „Reasoning“, also dem Durchdenken komplexer Probleme durch Zerlegung in Einzelschritte oder Trial-and-Error, wie es OpenAI und andere Unternehmen entwickeln, markiert einen potenziellen Sprung hin zu Systemen, die kognitive Aufgaben nicht nur ausführen, sondern scheinbar verstehen und kreativ bearbeiten können. Dies hat bereits zu messbaren Produktivitätssteigerungen geführt: Studien, etwa von MIT-Doktoranden zu Texterstellungsaufgaben oder von GitHub zur Softwareentwicklung mit Copilot, belegen eine Beschleunigung von Arbeitsabläufen um bis zu 55 Prozent. Diese „adaptive, lernfähige und flexible Problemlösungsfähigkeit“, so der MIT-Ökonom David Autor, stellt eine neue Qualität dar, die über die reine Automatisierung hinausgeht und tief in Denk- und Kreativprozesse eingreift.

Das ethische Minenfeld: Urheberrecht, Datenschutz und die Tücken der KI

Mit den wachsenden Fähigkeiten der KI potenzieren sich auch die ethischen und rechtlichen Herausforderungen. Die Nutzung urheberrechtlich geschützter Werke zum Training von KI-Modellen, wie die Klagen der New York Times gegen OpenAI und Microsoft verdeutlichen, wirft fundamentale Fragen zum geistigen Eigentum auf. Autorinnen wie Curtis Sittenfeld sehen sich mit der Situation konfrontiert, dass ihre Werke ohne Zustimmung und Vergütung zum Training von Systemen verwendet wurden, die nun potenziell in ihrem eigenen Stil schreiben können. Datenschutzbedenken manifestieren sich im bizarren Fall des Theaterprofessors David Mayer, dessen Name von ChatGPT zeitweise nicht genannt werden konnte, mutmaßlich aufgrund einer Verwechslung mit einer Person auf einer Terrorliste und einer fehlgeleiteten Datenschutzfunktion. Solche Vorfälle, ebenso wie das „Halluzinieren“ von Fakten oder das Erfinden von Quellen durch KI, unterstreichen die Notwendigkeit von Transparenz in den Algorithmen und klaren Verantwortlichkeiten bei Fehlleistungen. Die Blackbox-Natur vieler KI-Systeme erschwert es, Entscheidungen nachzuvollziehen und Fehlerquellen zu identifizieren.

Bildung im Umbruch: Zwischen Plagiatsangst und pädagogischer Innovation

Kaum ein Sektor ist von der rasanten Verbreitung von KI-Chatbots so unmittelbar betroffen wie das Bildungswesen. Die anfängliche Panik vor massenhaftem Betrug durch KI-generierte Hausarbeiten hat zu vielfältigen Reaktionen geführt: von Verboten der Technologie an einigen Schulen und Universitäten bis hin zu einer proaktiven Integration in den Unterricht. Professoren wie Antony Aumann an der Northern Michigan University gestalten Kurse um, fordern Entwürfe im Klassenzimmer oder mündliche Prüfungen und nutzen ChatGPT selbst als Diskussionsgegenstand, um kritisches Denken zu fördern. Bildungseinrichtungen wie die University of Florida oder die University at Buffalo setzen auf Aufklärung und die Anpassung von Richtlinien zur akademischen Integrität. Die Herausforderung besteht darin, neue Bewertungsmaßstäbe zu entwickeln, die nicht nur das Endprodukt, sondern den Lernprozess und die Fähigkeit zur kritischen Auseinandersetzung mit KI-generierten Inhalten berücksichtigen. Die Debatte, ob KI-Detektoren eine Lösung sind, ist im Gange, wobei deren Zuverlässigkeit, insbesondere bei nicht-muttersprachlichen Schreibstilen, kritisch hinterfragt wird, wie der Fall an der Texas A&M University zeigte.

Gespaltene Wahrnehmung: Die KI-Nutzung zwischen Euphorie und Skepsis

Die Perspektiven auf KI klaffen oft weit auseinander. Während einige Arbeitnehmer und Studierende KI als willkommenes Werkzeug zur Effizienzsteigerung und Arbeitserleichterung sehen, überwiegt bei anderen die Sorge vor Jobverlust oder einer Entwertung menschlicher Fähigkeiten. Eine Pew Research-Umfrage ergab, dass 80 Prozent der Amerikaner KI am Arbeitsplatz kaum nutzen und nur eine Minderheit von deren Vorteilen überzeugt ist; 52 Prozent äußerten sich besorgt. Besonders prekär wird die Situation, wenn Lehrende selbst KI-Tools für die Unterrichtsvorbereitung oder sogar für das Feedback auf studentische Arbeiten nutzen, während sie deren Einsatz durch Studierende untersagen – ein als heuchlerisch empfundener Widerspruch, der zu Beschwerden und sogar Forderungen nach Studiengebührenrückerstattung führen kann, wie der Fall an der Northeastern University zeigt. Diese Diskrepanzen bergen auch sozioökonomischen Sprengstoff: Studien deuten darauf hin, dass KI-Technologien die Einkommensungleichheit verschärfen könnten, indem sie vor allem Arbeitsplätze mit Routinetätigkeiten bedrohen und hochqualifizierte „Prompt Engineers“ oder KI-Strategen bevorteilen.

Die Kunst des richtigen Fragens: „Prompt Engineering“ als Schlüsselkompetenz

In einer Welt, in der KI-Modelle auf Kommando Texte, Bilder oder Analysen liefern, wird die Fähigkeit, diese Werkzeuge präzise und effektiv anzuleiten, zur entscheidenden neuen Kompetenz. Das sogenannte „Prompt Engineering“ – die Kunst, die richtigen Fragen und Anweisungen zu formulieren, um von der KI die gewünschten und qualitativ hochwertigen Ergebnisse zu erhalten – entwickelt sich zu einer gefragten Fähigkeit auf dem Arbeitsmarkt und im Bildungswesen. Es geht nicht mehr nur darum, was man weiß, sondern wie gut man KI als Partner nutzen kann, um Wissen zu generieren, zu verfeinern und anzuwenden. Dies erfordert ein tiefes Verständnis der Funktionsweise und der Grenzen der jeweiligen KI-Modelle sowie die Fähigkeit zur kritischen Bewertung der Ergebnisse.

Die Zukunft gestalten: Koexistenz und verantwortungsvolle Steuerung

Die langfristigen Visionen für die Zusammenarbeit von Mensch und KI sind von einer Mischung aus Optimismus und Vorsicht geprägt. Experten wie Dr. John Halamka von der Mayo Clinic Platform gehen davon aus, dass es in wenigen Jahren als Behandlungsfehler gelten könnte, KI nicht zu nutzen – stets im Zusammenspiel mit menschlicher Expertise. Selbst Geoffrey Hinton sieht die Zukunft in einer Kombination aus KI und Radiologen, die die Effizienz und Genauigkeit steigert. Doch dieser Übergang erfordert bewusste politische und unternehmerische Weichenstellungen. Es bedarf klarer Richtlinien zum Urheberrecht, zum Datenschutz und zur Haftung. Bildungssysteme müssen Curricula anpassen, um Medienkompetenz im Umgang mit KI zu vermitteln und kritisches Denken zu stärken, anstatt reines Faktenwissen abzuprüfen, das eine KI leicht replizieren kann. Die Herausforderung besteht darin, die unbestreitbaren Vorteile der KI zur Steigerung von Produktivität und zur Lösung komplexer Probleme zu nutzen, ohne dabei ethische Grundsätze zu verletzen, soziale Verwerfungen zu riskieren oder die Entwicklung menschlicher Kernkompetenzen zu vernachlässigen. Die aktuelle Phase ist somit ein entscheidendes Lernfeld für die Gesellschaft, um die Spielregeln für eine Zukunft zu definieren, in der künstliche Intelligenz ein integraler Bestandteil unseres Lebens sein wird.